基于Spark的泰坦尼克号生还数据处理分析

舟率率 3/11/2026 pythonscalasbt

原地址:https://dblab.xmu.edu.cn/blog/3679/

# 项目概况

# 数据类型

泰坦尼克号生还数据

# 开发环境

centos7

# 软件版本

python3.8.18、hadoop3.2.0、spark3.1.2、scala2.12.18、jdk8、sbt1.9.9

# 开发语言

python、Scala

# 开发流程

数据上传(hdfs)->数据分析(spark)->数据存储(本地文件)->可视化(matplotlib)

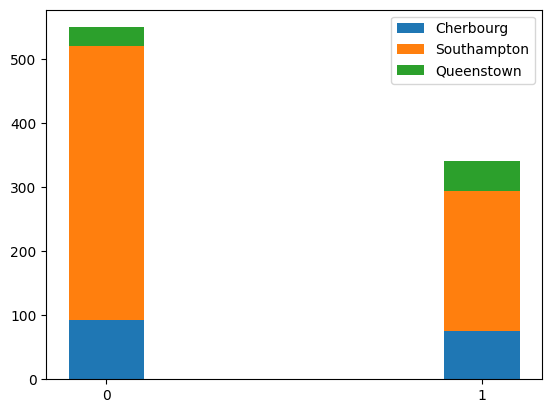

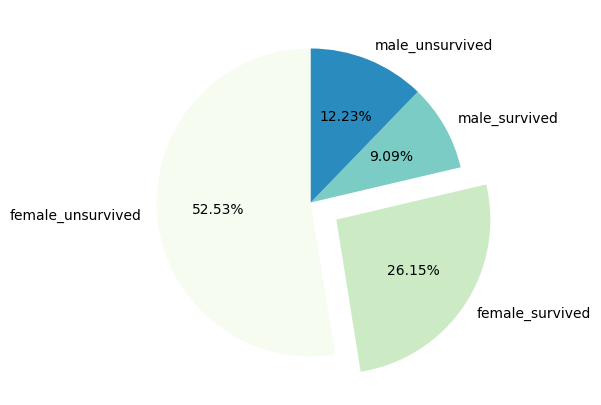

# 可视化图表

# 操作步骤

# python安装包

pip3 install pandas==2.0.3 -i https://pypi.tuna.tsinghua.edu.cn/simple/

pip3 install matplotlib==3.7.4 -i https://pypi.tuna.tsinghua.edu.cn/simple/

1

2

3

4

2

3

4

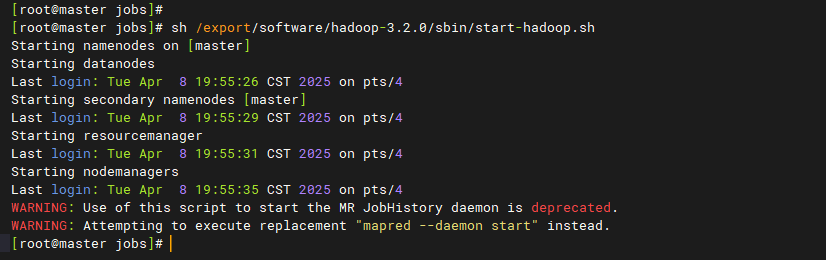

# 启动Hadoop

# 离开安全模式: hdfs dfsadmin -safemode leave

# 启动hadoop

bash /export/software/hadoop-3.2.0/sbin/start-hadoop.sh

1

2

3

4

5

2

3

4

5

# 准备目录

mkdir -p /data/jobs/project/

cd /data/jobs/project/

# 上传 "project-spark-titanic-survival-data-analysis" 整个文件夹 到 "/data/jobs/project/" 目录

1

2

3

4

5

6

2

3

4

5

6

# 上传文件到hdfs

cd /data/jobs/project/project-spark-titanic-survival-data-analysis/

hdfs dfs -mkdir -p /data/input/

hdfs dfs -rm -r /data/input/*

hdfs dfs -put data/titanic.csv /data/input/

hdfs dfs -ls /data/input/

1

2

3

4

5

6

7

8

2

3

4

5

6

7

8

# 程序打包

cd /data/jobs/project/project-spark-titanic-survival-data-analysis/

# 打包命令

sbt package

ls -l target/scala-2.12/spark-job.jar

1

2

3

4

5

6

7

8

2

3

4

5

6

7

8

# spark数据分析

cd /data/jobs/project/project-spark-titanic-survival-data-analysis/

spark-submit --class Titanic target/scala-2.12/spark-job.jar

1

2

3

4

5

2

3

4

5

# 启动可视化

cd /data/jobs/project/project-spark-titanic-survival-data-analysis/

python3 visualize.py /data/jobs/project/titanic_output/

1

2

3

4

5

2

3

4

5